Cela ressemble à une intrigue de Black Mirror : les élèves sont invités à identifier les objets correspondants, mais lorsqu'un robot sonne avec une réponse manifestement erronée, certains enfants répètent ce que le bot dit mot pour mot au lieu de puiser dans leur propre intelligence. Mais ce n’est pas de la science-fiction: une nouvelle étude publiée dans Science Robotics suggère que les enfants succombent facilement à la pression de leurs pairs par les robots.

Bill Andrews, de Discover, rapporte qu'une équipe de chercheurs allemands et britanniques a recruté 43 enfants âgés de 7 à 9 ans pour participer à l'expérience Asch, un test de conformité sociale se faisant passer pour un examen de la vision. L'expérience, qui a été développée pour la première fois dans les années 50, demande aux participants de comparer quatre lignes et d'identifier les deux longueurs correspondantes. La réponse est évidemment correcte, car les lignées ont des longueurs extrêmement variables et, lorsque les enfants ont été testés individuellement, ils ont donné la bonne réponse 87% du temps.

Une fois que les robots sont arrivés sur les lieux, cependant, les scores ont chuté à 75%.

«Lorsque les enfants étaient seuls dans la pièce, ils étaient assez doués pour la tâche, mais lorsque les robots ont pris la parole et ont donné de mauvaises réponses, ils n'ont fait que suivre les robots», a déclaré Tony Belpaeme, co-auteur de l'étude, un robotiste de l'Université de Plymouth. au Royaume-Uni, raconte James Vincent de The Verge.

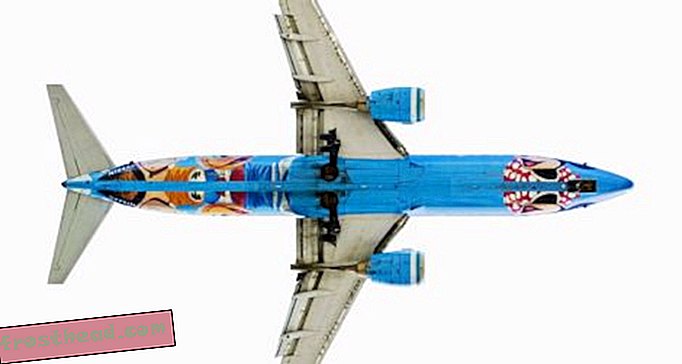

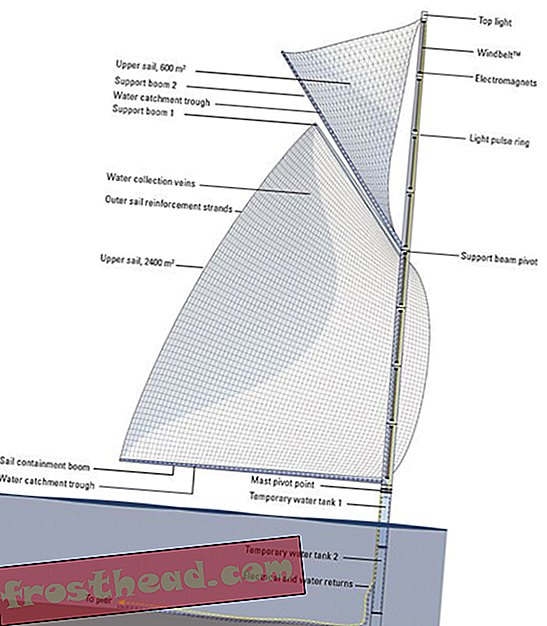

Sur la photo, le robot utilisé, la configuration de l'expérience et le "test de vision" montré aux participants (Vollmer et al.)

Sur la photo, le robot utilisé, la configuration de l'expérience et le "test de vision" montré aux participants (Vollmer et al.) Dans le nouvel environnement de test, un volontaire à la fois était assis à côté de trois robots humanoïdes. Bien que les lignes à évaluer restent très distinctes, les enfants participants doutaient d'eux-mêmes et se tournaient vers leurs homologues des robots pour obtenir des conseils. 74% des réponses incorrectes fournies par les enfants correspondaient à celles fournies par les robots mot pour mot.

Alan Wagner, ingénieur en aérospatiale à la Pennsylvania State University qui n'a pas participé à la nouvelle étude, explique à Carolyn Y. Johnson du Washington Post que la foi implacable que les humains placent souvent dans les machines est connue sous le nom de "biais d'automatisation".

«Les gens ont tendance à croire que ces machines en savent plus qu’elles, ont une conscience plus grande qu’elles-mêmes», note Wagner. "Ils les imprègnent de toutes ces propriétés incroyables et fantaisistes."

The Verge's Vincent écrit que les chercheurs ont effectué le même test sur un groupe de 60 adultes. Contrairement aux enfants, ces participants plus âgés ont collé leurs réponses, refusant de suivre les traces (incorrectes) des robots.

L'apparence discrète des robots a peut-être influencé le manque de confiance des participants adultes, explique Belpaeme.

"[Ils] n'ont pas assez de présence pour être influents", dit-il à Vincent. "Ils sont trop petits, trop toylike."

Les participants interrogés à la fin de l'examen ont vérifié la théorie des chercheurs, affirmant qu'ils supposaient que les robots fonctionnaient mal ou n'étaient pas suffisamment avancés pour fournir la réponse correcte. Il est possible, note Belpaeme, que si l'étude était répétée avec des robots plus autoritaires, les adultes se montreraient aussi vulnérables que les enfants.

Selon un communiqué de presse, les conclusions de l'équipe ont des implications de grande portée pour l'avenir de l'industrie de la robotique. Alors que les «robots sociaux autonomes» deviennent de plus en plus courants dans les domaines de l'éducation et du conseil aux enfants, les chercheurs ont averti que des mesures de protection devraient être prises pour «minimiser les risques pour les enfants pendant les interactions sociales enfant-robot».